El 21 de septiembre, OpenAI publica Whisper como modelo open source de reconocimiento automático de habla. Entrenado con 680,000 horas de audio en 99 idiomas, alcanza un Word Error Rate inferior al 3% en inglés. Este nivel de precisión hace que el subtitulado manual deje de ser viable económicamente para la mayoría de los casos de producción de video.

El modelo opera localmente sin depender de APIs comerciales. Procesa audio en tiempo real con hardware de consumo. La combinación de precisión, velocidad y costo cero elimina la barrera económica que mantenía el subtitulado manual como estándar de la industria.

Arquitectura del modelo y capacidades técnicas

Whisper implementa una arquitectura encoder-decoder basada en Transformers. El encoder procesa el espectrograma de audio en segmentos de 30 segundos. El decoder genera la transcripción token por token con atención cruzada sobre la representación del encoder.

El modelo se entrena con supervisión débil sobre datos de internet. No requiere transcripciones humanas perfectas. Aprende de subtítulos de YouTube, podcasts transcritos y audiolibros. Esta estrategia permite escalar el entrenamiento a 680,000 horas sin el costo prohibitivo de la transcripción manual profesional.

OpenAI publica cinco variantes del modelo:

- Tiny: 39M parámetros, procesa en CPU

- Base: 74M parámetros, balance velocidad-precisión

- Small: 244M parámetros, producción general

- Medium: 769M parámetros, alta precisión

- Large: 1550M parámetros, máxima calidad

El modelo small opera en tiempo real con una GPU de consumo. El modelo large alcanza el 3% de error en inglés pero requiere hardware más robusto. La arquitectura permite seleccionar el balance entre precisión y costo computacional según el caso de uso.

3% Word Error Rate en inglés con el modelo large

Impacto en el workflow de producción de video

El subtitulado manual cuesta entre $1.50 y $3.00 por minuto de video, donde un video de 60 minutos requiere entre $90 y $180 en transcripción profesional. El tiempo de entrega oscila entre 24 y 72 horas según la complejidad del audio y la disponibilidad del transcriptor.

Whisper procesa el mismo video en menos de 10 minutos con hardware de consumo. El costo operativo se reduce a la electricidad y la amortización del hardware. Para un productor que genera 100 horas de contenido mensual, el ahorro anual supera los $150,000 en costos directos de transcripción.

La velocidad de procesamiento cambia la viabilidad de casos de uso que antes no eran rentables:

- Subtitulado de contenido de archivo sin monetización directa

- Transcripción de reuniones internas y capacitaciones corporativas

- Generación de metadatos para búsqueda semántica en bibliotecas de video

- Subtítulos en tiempo real para eventos en vivo con latencia aceptable

El modelo no elimina la revisión humana en contextos donde la precisión absoluta es crítica. Contenido legal, médico o educativo formal requiere validación profesional. Pero la revisión de una transcripción automática cuesta entre $0.30 y $0.60 por minuto. El ahorro sigue siendo del 70% respecto al subtitulado manual desde cero.

Soporte multiidioma y casos de uso internacional

Whisper soporta 99 idiomas con niveles variables de precisión. El modelo alcanza menos del 5% de error en español, francés, alemán, italiano y portugués. Idiomas con menos datos de entrenamiento como el árabe, el hindi o el mandarín muestran tasas de error entre 8% y 15%.

La capacidad de traducción automática al inglés opera dentro del mismo modelo. Whisper puede transcribir audio en cualquier idioma soportado y generar la traducción al inglés en un solo paso. Esta funcionalidad elimina la necesidad de pipelines separados de transcripción y traducción.

Para productores de contenido en América Latina, el soporte nativo de español con menos del 5% de error hace viable la generación de subtítulos para todo el catálogo de archivo. Bibliotecas de miles de horas de contenido sin subtítulos pueden procesarse en semanas con hardware de consumo.

El modelo maneja acentos regionales y variaciones dialectales con degradación mínima de precisión. Audio con acento mexicano, argentino o colombiano genera transcripciones comparables en calidad. Esta robustez elimina la necesidad de modelos especializados por región geográfica.

99 Idiomas soportados con modelo único

Limitaciones técnicas y casos donde falla

Whisper degrada su precisión en condiciones de audio adversas. Ruido de fondo superior a -10dB SNR aumenta el error al 15-20%. Audio con múltiples hablantes simultáneos genera transcripciones con atribución incorrecta o pérdida de segmentos.

El modelo no identifica hablantes de forma nativa. La transcripción es un flujo continuo de texto sin marcadores de quién habla en cada momento. Casos de uso que requieren diarización de hablantes necesitan modelos adicionales como pyannote.audio o soluciones comerciales.

Terminología técnica especializada genera errores de transcripción. Nombres de productos, acrónimos de la industria o jerga profesional se transcriben fonéticamente en lugar de usar la ortografía correcta. Un video sobre CMAF (Common Media Application Format) puede generar transcripciones como «see-maf» o «seamaf».

La solución requiere fine-tuning del modelo con vocabulario específico del dominio. OpenAI no publica herramientas oficiales de fine-tuning para Whisper. La comunidad desarrolla soluciones no oficiales pero el proceso requiere experiencia en machine learning y acceso a GPUs de entrenamiento.

Audio con cambios de código entre idiomas confunde al modelo. Una conversación que alterna entre español e inglés genera transcripciones con errores en los puntos de transición. El modelo debe configurarse para un idioma primario y trata el otro idioma como ruido o lo transcribe fonéticamente.

Integración en pipelines de producción existentes

Whisper se distribuye como biblioteca de Python con dependencias mínimas. La instalación requiere torch, numpy y ffmpeg para procesamiento de audio. El modelo se descarga automáticamente en la primera ejecución y se cachea localmente.

La API de Python expone una función transcribe() que acepta rutas de archivo de audio o arrays de NumPy. El modelo retorna la transcripción completa con timestamps a nivel de segmento. Los timestamps permiten generar archivos .srt o .vtt sin procesamiento adicional.

La integración con sistemas de gestión de contenido requiere wrapper scripts que manejen la cola de procesamiento y el almacenamiento de resultados. Alterlatina implementa workers de Whisper que consumen jobs de una cola Redis y almacenan transcripciones en Azure Blob Storage con indexación en Azure Cognitive Search.

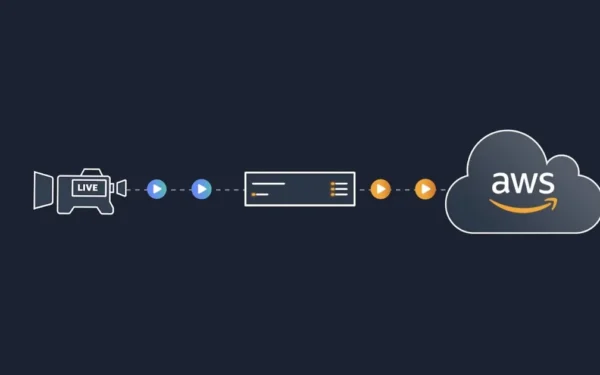

El pipeline completo opera así:

- Ingestión de video mediante upload directo o webhook de plataforma de streaming

- Extracción de audio con

ffmpega formatoWAV16kHz mono - Procesamiento con Whisper modelo

mediumen GPU dedicada - Generación de archivo

.srtcon timestamps sincronizados - Almacenamiento de transcripción en base de datos con referencia al video original

- Indexación de texto completo para búsqueda semántica

El throughput del sistema depende del hardware disponible, donde una GPU NVIDIA RTX 3090 procesa aproximadamente 10 horas de audio por hora de tiempo real con el modelo medium. Un servidor con 4 GPUs procesa 40 horas de contenido por hora, suficiente para la mayoría de los casos de producción.

Comparación con soluciones comerciales existentes

Antes de Whisper, las opciones de transcripción automática se dividían entre servicios cloud y modelos on-premise. Google Cloud Speech-to-Text cobra $0.024 por minuto de audio. AWS Transcribe cobra $0.024 por minuto. Azure Speech Services cobra $0.02 por minuto.

Para un productor que procesa 1000 horas mensuales, el costo de servicios cloud oscila entre $1,200 y $1,440 mensuales. El costo anual supera los $15,000. Whisper elimina este costo recurrente a cambio de inversión en hardware que se amortiza en menos de un año.

La precisión de Whisper es comparable o superior a servicios comerciales en la mayoría de los idiomas. Benchmarks independientes muestran que el modelo large supera a Google Cloud Speech-to-Text en inglés y español. Solo Azure Speech Services con modelos custom entrenados para dominios específicos supera a Whisper en precisión.

La ventaja de servicios cloud es la escalabilidad instantánea sin gestión de infraestructura. Un pico de 10,000 horas de contenido se procesa en paralelo sin inversión en hardware adicional. Whisper requiere planificación de capacidad y gestión de colas de procesamiento.

El modelo open source permite auditoría completa del funcionamiento interno. Organizaciones con requisitos de privacidad estrictos pueden operar Whisper sin enviar audio a terceros. Contenido confidencial, médico o legal se procesa localmente sin riesgo de exposición.

Preguntas frecuentes sobre Whisper de OpenAI

¿Qué nivel de precisión alcanza Whisper en español?

Whisper alcanza menos del 5% de Word Error Rate en español con el modelo large. La precisión es comparable a servicios comerciales como Google Cloud Speech-to-Text. El modelo maneja acentos regionales de América Latina sin degradación significativa de calidad.

¿Whisper puede procesar audio en tiempo real?

El modelo small procesa audio en tiempo real con una GPU de consumo como NVIDIA RTX 3060. El modelo large requiere hardware más potente y procesa a velocidad 0.5x en tiempo real. Para streaming en vivo, el modelo small es la opción viable con latencia aceptable.

¿Whisper vs transcripción humana?

Whisper alcanza 97% de precisión en inglés, comparable a transcriptores humanos no especializados. La ventaja es velocidad y costo. Un video de 60 minutos se procesa en menos de 10 minutos a costo cero. La transcripción humana toma 24-72 horas y cuesta entre $90 y $180.

¿Whisper soporta identificación de hablantes?

Whisper no incluye diarización de hablantes de forma nativa. La transcripción es un flujo continuo sin marcadores de quién habla. Para identificar hablantes se requiere integración con modelos adicionales como pyannote.audio o soluciones comerciales de diarización.

¿Necesita implementar transcripción automática en su pipeline de producción? Conozca nuestra ingeniería para Video Analytics con IA o inicie una consulta técnica con nuestros arquitectos de sistemas.