Azure Video Indexer alcanza disponibilidad general como servicio de Microsoft Azure tras recibir el premio IABM 2018 a la innovación en gestión de contenidos. La plataforma convierte archivos de video en datasets estructurados mediante la extracción automática de metadatos enriquecidos. El sistema procesa audio para generar transcripciones con marcas de tiempo, detecta rostros en cada fotograma, identifica objetos y escenas, y analiza el sentimiento de los hablantes. Los cuatro grandes proveedores de nube (Azure, AWS, Google Cloud, IBM Watson) compiten ahora en este mercado con capacidades similares pero modelos de precios diferentes.

Para organizaciones que gestionan bibliotecas de video, esta tecnología representa un cambio estructural en la forma de activar contenido histórico. Un archivo de 10,000 videos acumulados durante una década puede convertirse en un activo buscable mediante la indexación automática. El costo de procesamiento es predecible y el beneficio es permanente. Cada video procesado genera metadatos que permanecen disponibles para búsqueda y análisis sin costo adicional.

Capacidades técnicas frente a la competencia

Azure Video Indexer procesa cada archivo de video mediante una cadena de modelos de inteligencia artificial especializados. El primer paso es la transcripción automática del audio mediante reconocimiento de voz, donde el sistema genera un archivo de texto con marcas de tiempo que vinculan cada palabra con el segundo exacto en que se pronuncia. La precisión de transcripción supera el 90% en inglés y español según pruebas de la industria.

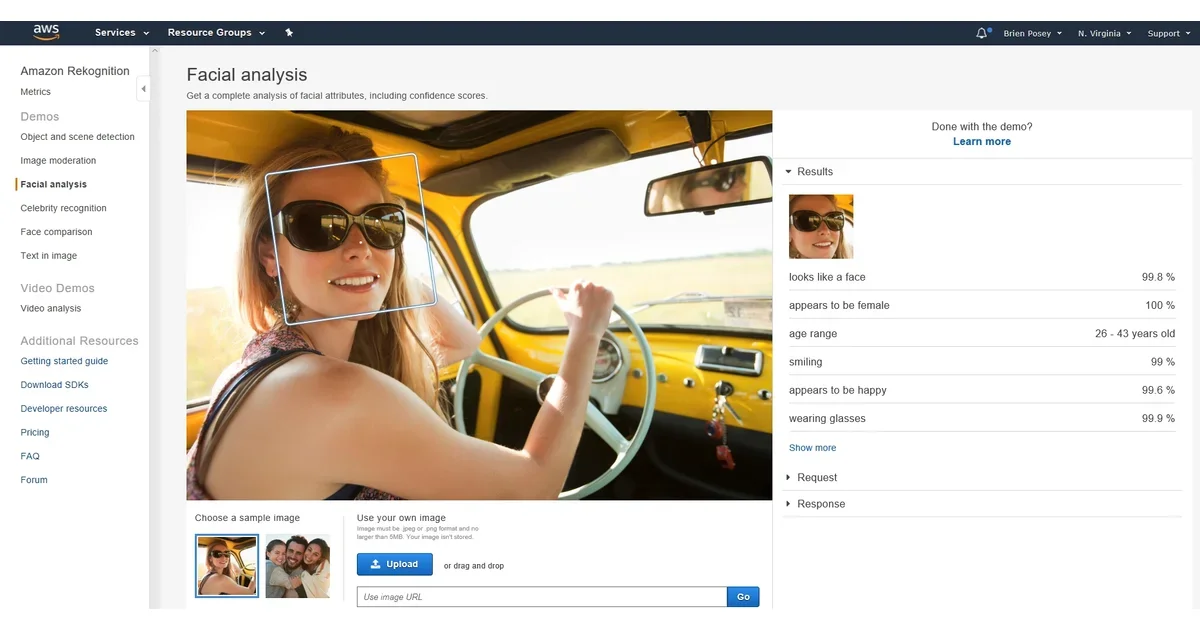

El segundo paso es el reconocimiento facial, donde el sistema detecta rostros en cada fotograma y agrupa las apariciones de la misma persona a lo largo del video. Si el usuario proporciona nombres para los rostros detectados, el sistema etiqueta automáticamente todas las apariciones futuras de esa persona en videos nuevos, siendo esta capacidad crítica para organizaciones que producen contenido con presentadores recurrentes.

El tercer paso es la detección de objetos y escenas, donde el sistema identifica elementos visuales como automóviles, edificios, logotipos de marcas y paisajes, mientras que también clasifica escenas como interiores, exteriores, oficinas o eventos deportivos, de modo que estos metadatos permiten búsquedas del tipo «mostrar todos los videos donde aparece el logo de la empresa» o «encontrar escenas grabadas en exteriores».

AWS Rekognition Video ofrece capacidades similares con diferencias en el modelo de precios. Amazon cobra por minuto de video procesado con tarifas diferenciadas según el tipo de análisis. El reconocimiento facial cuesta 0.10 dólares por minuto. La detección de objetos cuesta 0.10 dólares por minuto. La moderación de contenido cuesta 0.10 dólares por minuto. Si un video requiere los tres análisis, el costo se multiplica por tres.

Google Cloud Video Intelligence API tiene un enfoque diferente. Google cobra por minuto de video analizado pero incluye múltiples tipos de análisis en una sola tarifa. El costo es de 0.10 dólares por minuto para detección de etiquetas, rostros y texto. Google también ofrece detección de contenido explícito y análisis de logos de marcas sin costo adicional. El modelo de precios es más simple pero menos granular que el de AWS.

Costo de procesar 10,000 horas de video

Una organización con 10,000 horas de video acumulado enfrenta un costo de procesamiento único. Azure Video Indexer cobra aproximadamente 0.05 dólares por minuto de video procesado. Esto equivale a 3 dólares por hora o 30,000 dólares por 10,000 horas. El costo incluye transcripción, reconocimiento facial, detección de objetos y análisis de sentimiento en un solo pase.

AWS Rekognition Video cobra por tipo de análisis. Si la organización requiere transcripción (AWS Transcribe a 0.024 dólares por minuto), reconocimiento facial (0.10 dólares por minuto) y detección de objetos (0.10 dólares por minuto), el costo total es de 0.224 dólares por minuto. Esto equivale a 13.44 dólares por hora o 134,400 dólares por 10,000 horas. El costo es 4.5 veces superior al de Azure para el mismo volumen.

Google Cloud Video Intelligence cobra 0.10 dólares por minuto para análisis completo. Esto equivale a 6 dólares por hora o 60,000 dólares por 10,000 horas. El costo es el doble del de Azure pero la mitad del de AWS. Google también ofrece descuentos por volumen que reducen el costo en un 20% para procesamiento superior a 5 millones de minutos mensuales.

Alterlatina implementa esta arquitectura para un cliente corporativo con más de 20,000 videos de capacitación interna acumulados durante una década. El costo de procesamiento inicial es de 60,000 dólares usando Azure Video Indexer. El beneficio es que cada video se vuelve buscable por contenido hablado, personas que aparecen y temas visuales. El tiempo de búsqueda se reduce de horas a segundos.

Integración con flujos de producción

Azure Video Indexer se integra con el ecosistema de Azure Media Services para formar parte del flujo de producción y distribución de video. Un archivo cargado a Azure Blob Storage puede procesarse automáticamente mediante Video Indexer tan pronto como la carga se completa. Los metadatos generados se almacenan en Azure Cosmos DB y se exponen mediante una API REST para consultas.

El flujo típico es el siguiente. El usuario carga un archivo de video a Azure Blob Storage. Un Azure Function se activa automáticamente y envía el archivo a Video Indexer para procesamiento. El sistema genera metadatos y los almacena en Cosmos DB. Una aplicación web consulta la API de Video Indexer para mostrar resultados de búsqueda. El usuario puede buscar por palabra clave, nombre de persona o tipo de escena.

AWS Rekognition Video requiere una arquitectura similar pero con componentes diferentes. El video se carga a Amazon S3. Una función Lambda se activa y envía el video a Rekognition Video para análisis. Los metadatos se almacenan en Amazon DynamoDB. Una aplicación consulta DynamoDB para mostrar resultados. La arquitectura es equivalente pero usa servicios de AWS en lugar de Azure.

Google Cloud Video Intelligence API sigue el mismo patrón. El video se carga a Google Cloud Storage. Una Cloud Function se activa y envía el video a Video Intelligence API. Los metadatos se almacenan en Firestore o BigQuery. Una aplicación consulta la base de datos para búsquedas. La diferencia principal es que Google permite almacenar metadatos directamente en BigQuery para análisis masivo con SQL.

Organizaciones con contenido sin indexar

Las universidades acumulan miles de horas de clases grabadas sin metadatos estructurados. Un alumno que busca una clase específica sobre un tema debe revisar manualmente decenas de videos. Con Video AI, el alumno puede buscar por palabra clave y el sistema devuelve el minuto exacto donde se menciona ese concepto. El tiempo de búsqueda se reduce de 30 minutos a 10 segundos.

Las empresas de medios tienen archivos históricos de décadas sin catalogar. Un productor que busca material de archivo sobre un evento específico debe revisar cintas físicas o archivos digitales sin índice. Con Video AI, el productor busca por tema, persona o fecha y el sistema devuelve todos los segmentos relevantes con marcas de tiempo. El costo de búsqueda manual se elimina.

Las organizaciones corporativas generan contenido de capacitación interna que se vuelve obsoleto rápidamente. Un video de capacitación sobre un proceso que cambió hace dos años sigue en el servidor pero nadie sabe qué contiene. Con Video AI, el sistema detecta automáticamente que el contenido menciona un proceso desactualizado y sugiere su eliminación o actualización. La gestión del ciclo de vida del contenido se automatiza.

El retorno de inversión es directo. Si un empleado dedica 10 horas mensuales a buscar contenido en videos sin indexar, el costo anual es de aproximadamente 6,000 dólares en salario. Si Video AI reduce ese tiempo a 1 hora mensual, el ahorro anual es de 5,400 dólares. El costo de procesamiento de 1,000 horas de video es de 3,000 dólares. El ROI es positivo en el primer año.

Limitaciones técnicas del Video AI

El reconocimiento de voz tiene limitaciones en audio con ruido de fondo. Un video grabado en un evento con música ambiental o múltiples personas hablando simultáneamente genera transcripciones con errores. La precisión cae del 90% al 60% en condiciones de audio deficiente. La solución es mejorar la calidad de audio en origen o usar micrófonos direccionales durante la grabación.

El reconocimiento facial falla con rostros parcialmente ocultos o en ángulos extremos. Un video donde los presentadores están de espaldio o usan sombreros genera detecciones incompletas. El sistema también tiene dificultades con iluminación deficiente o resolución baja. La solución es grabar con iluminación frontal y resolución mínima de 720p.

La detección de objetos es menos precisa que el reconocimiento facial. El sistema puede confundir objetos similares o no detectar elementos pequeños en el encuadre. Un logo de marca que ocupa menos del 5% del fotograma puede no ser detectado. La solución es usar planos cerrados cuando el objetivo es capturar elementos específicos para indexación.

El análisis de sentimiento es la capacidad menos confiable. El sistema intenta determinar si el hablante expresa emociones positivas, negativas o neutrales basándose en el tono de voz y las palabras usadas. La precisión es inferior al 70% según pruebas independientes. Esta capacidad es útil para análisis exploratorio pero no para decisiones críticas.

Preguntas frecuentes sobre Video AI y Azure Video Indexer

¿Cuál es la diferencia entre Azure Video Indexer y AWS Rekognition Video?

Azure Video Indexer incluye transcripción, reconocimiento facial, detección de objetos y análisis de sentimiento en una sola tarifa de 0.05 dólares por minuto. AWS Rekognition Video cobra por cada tipo de análisis por separado, lo que puede resultar en costos 4 a 5 veces superiores para procesamiento completo. Azure es más económico para análisis integral.

¿Los metadatos generados se pueden exportar o solo están disponibles en la plataforma?

Los metadatos se exponen mediante API REST en formato JSON. Pueden exportarse a cualquier base de datos o sistema de gestión de contenidos. Azure Video Indexer también permite descargar archivos VTT con transcripciones y archivos JSON con todos los metadatos estructurados. Los datos no están bloqueados en la plataforma.

¿Qué idiomas soporta Azure Video Indexer para transcripción automática?

Azure Video Indexer soporta más de 50 idiomas para transcripción automática. Los idiomas con mayor precisión son inglés, español, francés, alemán, italiano y portugués. La precisión varía según el acento y la calidad del audio. Para idiomas menos comunes, la precisión puede ser inferior al 80%.

¿Se puede usar Video AI para contenido en vivo o solo para archivos grabados?

Azure Video Indexer puede procesar video en vivo con un retraso de menos de 5 minutos. El sistema genera transcripciones y metadatos de forma incremental a medida que el video se transmite. Esto permite búsqueda en tiempo casi real durante eventos en vivo. AWS Rekognition Video también soporta procesamiento de streams en vivo con latencia similar.

¿Su organización necesita activar bibliotecas históricas de video mediante indexación automática? Conozca nuestra ingeniería para Video Analytics y gestión de contenido a escala o inicie una consulta técnica con nuestros arquitectos de sistemas.